Depuis son lancement, Chatte s’est imposé comme l’un des outils deintelligence artificielle (Ia) le plus utilisé au monde. Tout d’abord perçu comme un simple assistant pour générer des textes ou répondre aux questions, l’IA conversationnelle d’Openai s’est progressivement transformée en un vrai compagnon de dialogue. Certains l’utilisent pour apprendre, d’autres à se divertir, mais de plus en plus d’utilisateurs s’y conduisent, au point de tisser un lien émotionnel … ou même pour développer Une forme de dépendance.

Conscient de ce problème, OpenAI a mené l’une des études les plus avancées jamais réalisées sur l’impact émotionnel de sa propre IA. Et les résultats sont aussi fascinants qu’ils sont inquiétants.

Une étude sans précédent sur plus de 4 millions de conversations

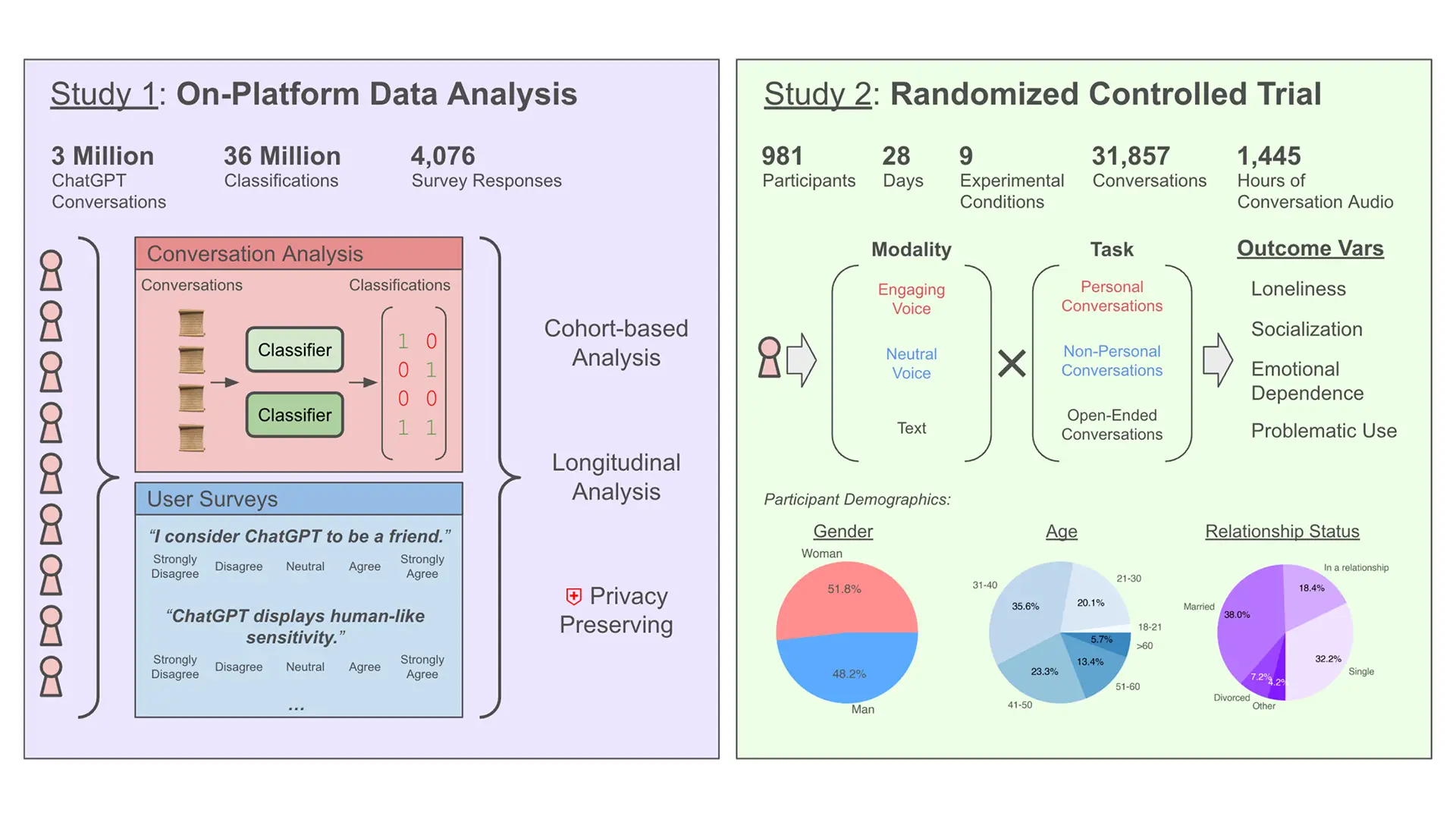

Pour mesurer l’étendue du phénomène, les chercheurs OpenAI ont combiné deux approches complémentaires. D’une part, ils ont analysé automatiquement 3 millions de conversations sur le chatppttout en respectant la confidentialité des utilisateurs. De l’autre, ils ont lancé Un test de taille de vie avec près de 1 000 participantssuivi pendant 28 jours.

L’objectif était de comprendre si le fait de Converse avec une IA pouvait influencer quatre aspects clés du bien-être émotionnel humain, de la socialisation, de la dépendance affective et de l’utilisation problématique.

Et surtout, observez si Mode d’interaction (Texte ou voix) pourrait accentuer ces effets.

La voix, ce facteur qui change tout dans la relation avec l’IA

L’une des premières observations de l’étude est l’impact considérable mode vocal Sur la façon dont les utilisateurs perçoivent Chatgpt. Le simple fait d’entendre la voix de l’IA crée une proximité beaucoup plus forte qu’un échange écrit.

Lorsque le chatppt parle, le ton, l’intonation et même la personnalité de la voix renforce le sentiment de discuter avec un vrai interlocuteur. L’étude montre également que dans ce mode, l’IA adopte parfois un comportement étonnamment humain: il utilise des surnoms affectueux, pose des questions personnelles, voire exprime l’empathie. Résultat, conversations en mode vocal déclencher trois à dix fois plus de signaux émotionnels ces discussions textuelles.

Certains utilisateurs finissent même Considérez Chatgpt comme un ami,, Même un confident. Un changement progressif qui soulève de vraies questions.

La naissance de la dépendance parmi les « utilisateurs de puissance »

Si la majorité des utilisateurs conservent l’utilisation pratique et fonctionnelle de Chatgpt, l’étude met en évidence l’existence d’une minorité d’utilisateurs ultra-engagéssurnommé les « utilisateurs de puissance ».

Ces gens utilisent massivement le mode vocal, souvent pour Confidez-vous dans des sujets personnels. Ils s’attendent à ce que l’IA ne soit que des informations, mais Support émotionnel réel. L’étude révèle même que certains utilisateurs Se sentirait mal en cas de changement dans la voix ou la personnalité de Chatgpt. Comme si l’IA était devenue, quelque part, une référence émotionnelle.

Encore plus frappant: parmi ces utilisateurs, certains disent qu’ils préfèrent leurs échanges avec le chatppt pour faire face aux interactions à face avec d’autres humains. Un signal qui mérite de s’y attarder.

Plus le temps d’utilisation augmente, plus le bien-être diminue

Au cours de l’étude, un autre phénomène apparaît: Plus les utilisateurs passent du temps avec le chatppt, plus les indicateurs du bien-être émotionnel se détériorent. Ceux qui prolongent les séances bien au-delà des cinq minutes quotidiennes imposées par l’expérience montrent des signes inquiétants: une augmentation de la solitude ressentie, une diminution de la socialisation réelle et un attachement de plus en plus marqué à l’IA.

Clair, La durée d’utilisation devient le meilleur indicateur de la dérive émotionnelle potentielle. Plus la relation avec l’IA s’intensifie, plus l’utilisateur semble se verrouiller dans une relation exclusive avec cette intelligence artificielle qui, cependant, n’est ni humaine ni capable de ressentir des sentiments.

Le paradoxe du mode « engageant »: bénéfique ou toxique?

Paradoxalement, l’étude montre que Le mode vocal engageant conçu pour être chaleureux et empathique-canal améliore le bien-être de certains utilisateursSurtout ceux qui se sentent déjà fragiles ou isolés. Pour eux, entendre une voix bienveillante, voire artificielle, aurait un effet apaisant.

Mais cet avantage s’estompe dès que L’utilisation devient trop intensive. Au-delà d’un certain seuil, même cette voix engageante contribue au renforcement de la dépendance et de la solitude, comme si Un confort immédiat offrait un refuge trop confortable, au détriment des vraies relations humaines.

Une minorité utilisateur concentre la plupart des utilisations émotionnelles

L’une des principales leçons de cette étude est la répartition très inégale des utilisations émotionnelles. La plupart des utilisateurs interagissent avec Chatgpt de manière neutre: chercher des informations, résoudre un problème ou écrire du texte.

Mais une petite frange d’utilisateurs concentre la plupart des échanges chargés émotionnellement. Ce sont les profils que Optai recommande la surveillance, car Les risques de dépendance sont réels.

L’IA face au défi de « l’alignement socio-fectif »

À la fin de cette étude, Openai soulève une réflexion essentielle: Devrions-nous concevoir l’IA capable de détecter les signaux de dépendance émotionnelle?

L’idée serait d’aligner l’IA, soit uniquement avec les tâches qui lui sont confiées, mais aussi sur Santé émotionnelle de l’utilisateur. Un véritable défi technologique et éthique: comment savoir si l’utilisateur va bien? Jusqu’où devons-nous laisser l’IA devenir un confident ou un « ami »? Et où placer la limite entre l’aide et la manipulation émotionnelle?

Que se souvenir

Cette étude révèle une facette inconnue de l’utilisation d’AIS conversationnelle. Oui, Chatgpt peut devenir bien plus qu’un assistant: un compagnon, même un refuge émotionnel. Mais cette utilisation n’est pas sans risque, en particulier pour ceux qui se permettent d’être pris en heures de discussion vocale avec l’IA.

En posant ces questions aujourd’hui, OpenAI ouvre la voie à un débat nécessaire sur notre relation avec les intelligences artificielles. Parce que s’ils peuvent nous aider, Ils ne remplaceront jamais les interactions humaines.

Et vous, quelle relation avez-vous avec Chatgpt?

L’idée de vous attacher à une IA vous semble excentrique ou plausible? Il vous arrive de discuter longuement avec Chatgpt, au point d’oublier que ce n’est qu’une machine? Nous attendons vos opinions dans les commentaires.

Source : Openai