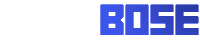

Face à l’essor de l’intelligence artificielle dans l’édition en ligne, Wikipédia vient de clarifier ses règles. L’encyclopédie collaborative a décidé d’interdire l’utilisation de grands modèles linguistiques pour générer ou réécrire le contenu des articles, une évolution importante dans la gouvernance éditoriale de la plateforme. Cette décision s’inscrit dans un mouvement de fond : à mesure que les outils génératifs gagnent du terrain dans les médias, les plateformes basées sur la fiabilité et la « vérifiabilité » de l’information renforcent leurs garde-fous.

Une règle plus stricte pour protéger la qualité des articles

La nouvelle formulation adoptée par la communauté anglophone de Wikipédia laisse peu de place à l’ambiguïté. Le principe est désormais explicite : l’utilisation du LLM pour produire ou reformuler des contenus encyclopédiques est totalement interdite. Cette précision renforce une recommandation antérieure, plus vague, qui visait principalement la création d’articles entiers à l’aide d’outils génératifs.

En fait, Wikipédia cherche avant tout à limiter les risques bien connus de l’IA générative : erreurs factuelles, formulations attractives mais trompeuses, extrapolations non sourcées et subtiles altérations de sens. Pour une encyclopédie fondée sur des références vérifiables, ce type de dérive représente évidemment un danger structurel.

Un vote massif des contributeurs en faveur de la restriction

Ce changement de règle n’est pas venu d’en haut. Il a été soutenu par la communauté des contributeurs, suite à un vote très largement favorable, avec 40 voix pour et 2 contre. Ce résultat montre à quel point la question est devenue sensible auprès des bénévoles qui entretiennent quotidiennement l’encyclopédie.

Cette fermeté ne traduit cependant pas un rejet absolu de l’intelligence artificielle, mais plutôt une volonté d’encadrer précisément ses usages. Wikipédia ne ferme donc pas totalement la porte aux outils automatisés, mais refuse surtout de leur permettre de devenir des « auteurs invisibles » dans un projet où la responsabilité humaine reste centrale.

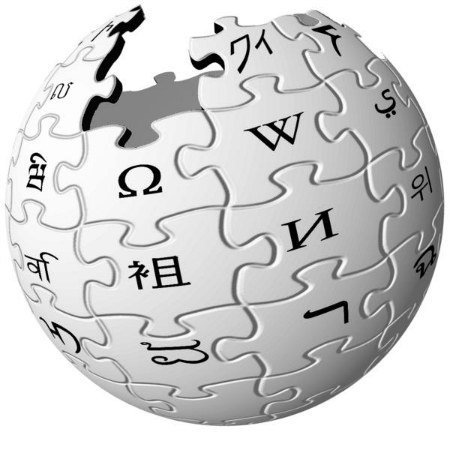

Deux usages restent tolérés sous surveillance humaine

Les éditeurs peuvent toujours utiliser un LLM pour suggérer de très légères corrections stylistiques à leurs propres textes, à condition qu’aucun nouveau contenu ne soit introduit. Une autre exception demeure pour certains travaux de traduction, pour autant que la vérification humaine reste complète et rigoureuse.

Les instructions officielles soulignent également ce point : les contributeurs peuvent reprendre certaines suggestions après relecture, mais avec prudence, car un modèle peut modifier le sens d’un passage au-delà de la demande initiale et produire une formulation qui n’est plus correctement soutenue par les sources citées.

Un signal fort pour tout l’écosystème éditorial

En traçant cette ligne, Wikipédia envoie un message clair à l’industrie de l’édition numérique. L’IA peut assister, corriger légèrement ou accélérer certaines tâches techniques, mais elle ne doit pas remplacer le travail éditorial lorsqu’il s’agit de produire des connaissances documentées. Dans un contexte où la crédibilité des contenus devient un enjeu majeur, cette décision pourrait inspirer d’autres plateformes soucieuses de préserver leurs standards éditoriaux sans céder à l’automatisation totale.