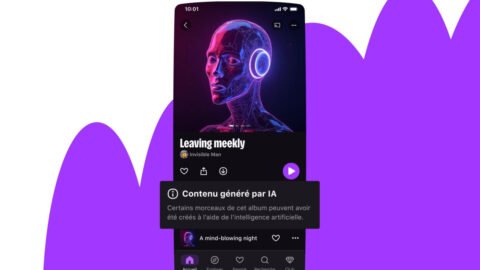

YouTube étend à Hollywood sa fonction de détection des deepfakes générée par l’IA, ce qui pourrait conduire à la suppression de certaines vidéos mettant en vedette des célébrités. Derrière cet élargissement, la plateforme ne se limite pas à la suppression de contenus : elle commence aussi à structurer la gestion de l’image de synthèse des artistes.

L’outil permet aux personnalités publiques de repérer sur YouTube les contenus d’IA qui reproduisent leur visage, puis de demander leur suppression. Cependant, toutes les demandes ne seront pas acceptées car l’examen reste régi par la politique de confidentialité de la plateforme appartenant à Google et permet de conserver des usages protégés comme la parodie ou la satire.

Contrôle étendu, mais pas automatique

YouTube a d’abord lancé les tests auprès des créateurs l’automne dernier, avant d’étendre le programme aux politiciens et aux journalistes en mars. L’ouverture aux célébrités marque donc une nouvelle étape, avec une couverture même pour des personnalités qui ne possèdent pas elles-mêmes de compte YouTube.

Pour rejoindre le programme, les participants doivent fournir une pièce d’identité et une vidéo selfie. La détection se concentre sur le visage et n’inclut pas, à ce stade, la voix ou d’autres éléments d’identification.

Cependant, le système n’offre aucun droit de suppression automatique. YouTube noté de plus, les créateurs déjà intégrés au programme n’ont demandé la suppression que d’un très petit nombre de vidéos, ce qui montre que l’outil sert autant à surveiller l’utilisation d’une image qu’à supprimer massivement du contenu.

Vers une monétisation des deepfakes de l’IA ?

YouTube associe cette fonction à Content ID, son outil de localisation de contenu protégé par le droit d’auteur. La comparaison présente une limite importante : contrairement à Content ID, la détection d’apparence ne permet pas encore aux personnes concernées de monétiser les vidéos tierces utilisant leur image.

C’est pourtant la direction suggérée par l’ensemble du système. La plateforme a récemment annoncé une fonctionnalité permettant aux créateurs de cloner numériquement leur apparence avec l’IA pour l’insérer dans des vidéos, tandis que l’agence CAA, qui a soutenu l’expansion du programme, dispose déjà d’une base de données biométriques de ses clients pour protéger ou exploiter commercialement leur image.

Cette logique ouvre plusieurs scénarios pour Hollywood. Certaines célébrités voudront que les deepfakes d’IA les ciblant soient supprimés, d’autres pourraient tolérer les créations de fans et une partie de l’industrie pourrait finir par accepter ces utilisations à condition de contrôler le cadre et d’en capter les revenus.