Après avoir proposé la détection d'images générées par l'intelligence artificielle, Google franchit une nouvelle étape dans la lutte contre la désinformation. Gémeaux permet maintenant pour analyser les fichiers vidéo afin de déterminer s'ils ont été créés ou modifiés par l'IA de Google. Cette fonctionnalité, promise lors du lancement de Nano Banana Pro, est disponible dès maintenant dans tous les pays et langues supportés par l'application.

Analyse précise via le filigrane SynthID

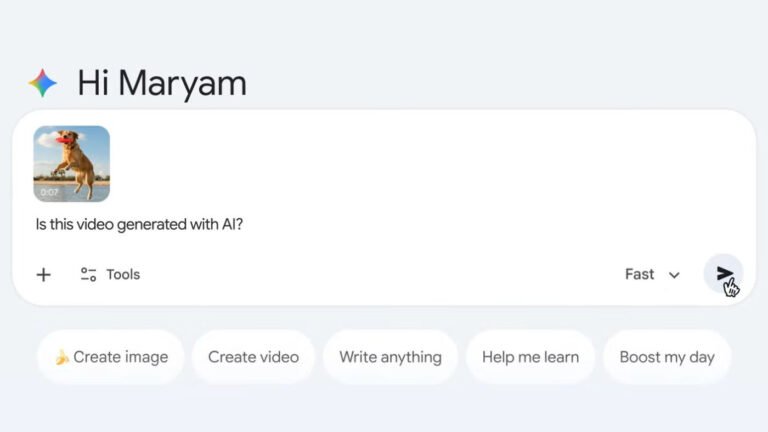

Le processus de vérification repose sur la technologie SynthID, un filigrane numérique imperceptible intégré aux outils de Google. Pour l'utiliser, envoyez simplement une vidéo à Gemini et posez une question directe, telle que : « Cela a-t-il été généré à l'aide de l'IA de Google ? » ».

L'outil scanne ensuite les pistes visuelles et audio à la recherche de cette signature numérique. La réponse fournie est détaillée et opportune. Les Gémeaux peuvent par exemple indiquer : « SynthID détecté dans l'audio entre 10 et 20 secondes. Aucun SynthID détecté dans les visuels ».

Les utilisateurs doivent toutefois respecter certaines contraintes techniques. La taille maximale du fichier est de 100 Mo, ce qui n’est pas très volumineux. De plus, la durée maximale est de 90 secondes.

Les limites d'un système fragmenté

Si cette nouveauté est sympathique, elle se heurte à un problème structurel majeur : le manque de standardisation. La détection ne fonctionne que si le contenu porte le filigrane SynthID. Cependant, bien que Google et des partenaires comme Nvidia ou Hugging Face l’utilisent, le reste de l’écosystème de l’IA ne l’a pas adopté. Par conséquent, Gemini reste aveugle aux photos et vidéos générées par des outils concurrents qui ne sont pas partenaires.

La robustesse de ces marquages pose également question. OpenAI en a fait l'expérience avec son application Sora, où les filigranes se sont révélés faciles à supprimer. Google assure que son propre marqueur est imperceptible, mais sa résistance aux manipulations reste à prouver. De plus, bien que le modèle de génération d’images Nano Banano intègre les métadonnées C2PA, le manque de coordination entre les réseaux sociaux pour étiqueter systématiquement les contenus générés par l’IA laisse encore le champ libre à la circulation de nombreux deepfakes non détectés.